Introducere în Bagging și Boosting

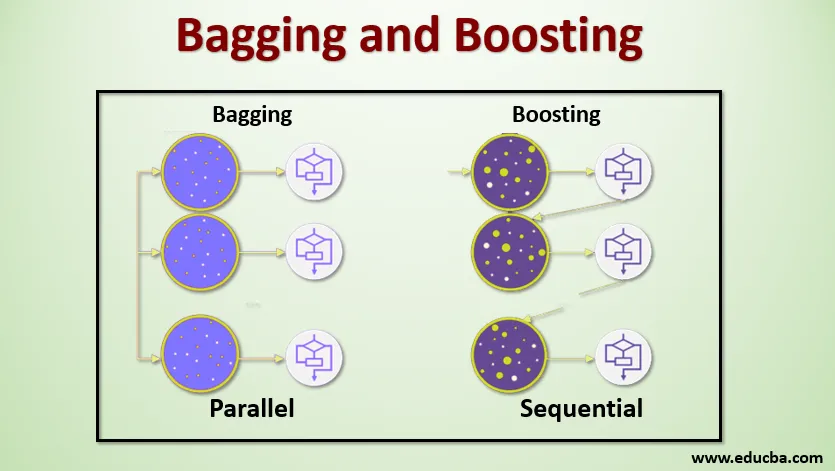

Bagging și Boosting sunt cele două metode populare de ansamblare. Deci, înainte de a înțelege Bagging and Boosting, să avem o idee despre ce este învățarea prin ansamblu. Este tehnica de a utiliza mai mulți algoritmi de învățare pentru a antrena modele cu același set de date pentru a obține o predicție în învățarea automată. După obținerea predicției de la fiecare model, vom folosi tehnici de mediere a modelelor, cum ar fi media ponderată, variația sau votul maxim pentru a obține predicția finală. Această metodă își propune să obțină predicții mai bune decât modelul individual. Acest lucru duce la o precizie mai bună, evitând supraajustarea și reduce prejudecățile și co-variația. Două metode populare de ansamblu sunt:

- Bagging (Agregarea de bootstrap)

- stimularea

Bagging:

Bagajul, cunoscut și sub denumirea de Bootstrap Aggregating, este utilizat pentru a îmbunătăți precizia și face ca modelul să se generalizeze mai mult prin reducerea variației, adică prin evitarea supraajustării. În acest sens, luăm mai multe subseturi ale setului de date de instruire. Pentru fiecare subset, luăm un model cu aceiași algoritmi de învățare precum arborele de decizie, regresia logistică etc. pentru a prezice ieșirea pentru același set de date de testare. Odată ce avem o predicție de la fiecare model, atunci folosim o tehnică de mediere a modelului pentru a obține rezultatul final al predicțiilor. Una dintre celebrele tehnici utilizate în Bagging este Random Forest . În pădurea Random, folosim mai mulți arbori de decizie.

Stimularea :

Boosting este utilizat în principal pentru a reduce prejudecata și variația într-o tehnică de învățare supravegheată. Se referă la familia unui algoritm care transformă elevii slabi (elevul de bază) în studenți puternici. Elevul slab este clasificatorul care este corect doar într-o mică măsură cu clasificarea efectivă, în timp ce elevii puternici sunt clasificatorii care sunt bine corelați cu clasificarea reală. Puține tehnici celebre de Boosting sunt AdaBoost, GRADIENT BOOSTING, XgBOOST (Extreme Gradient Boosting). Deci, acum știm care sunt bagajul și stimularea și care sunt rolurile lor în învățarea mașinii.

Lucrări de bagaj și de stimulare

Acum să înțelegem cum funcționează bagajul și stimularea:

Bagging

Pentru a înțelege funcționarea lui Bagging, presupunem că avem un număr de N de modele și un set de date D. Unde m este numărul de date și n este numărul de caracteristici din fiecare date. Și trebuie să facem o clasificare binară. În primul rând, vom împărți setul de date. Deocamdată, vom împărți acest set de date numai în formare și set de teste. Să numim setul de date de instruire ca unde se află numărul total de exemple de instruire.

Ia un eșantion de înregistrări din setul de antrenament și folosește-l pentru a antrena primul model, spune m1. Pentru modelul următor, m2 reamplează setul de antrenament și ia un alt eșantion din setul de antrenament. Vom face același lucru pentru numărul N de modele. Având în vedere că recampionăm setul de date de formare și prelevăm probele din acesta fără a elimina nimic din setul de date, s-ar putea să avem două sau mai multe înregistrări de date de formare comune în mai multe probe. Această tehnică de reeșantionare a setului de date de formare și furnizarea eșantionului modelului este denumită Eșantionare în Rând cu Înlocuire. Să presupunem că am antrenat fiecare model și acum vrem să vedem predicția pe datele testelor. Întrucât lucrăm la o clasificare binară, rezultatul poate fi 0 sau 1. Setul de date test este transmis fiecărui model și obținem o predicție de la fiecare model. Să spunem că din N modele mai mult decât modelele N / 2 au prezis că va fi 1, Prin urmare, folosind tehnica de mediere a modelului ca vot maxim, putem spune că rezultatul prevăzut pentru datele de testare este 1.

stimularea

În impuls, preluăm înregistrări din setul de date și le transmitem cursanților de bază secvențial, aici studenții de bază pot fi orice model. Să presupunem că avem m număr de înregistrări în setul de date. Apoi trecem câteva înregistrări către cursantul de bază BL1 și îl formăm. Odată ce BL1 este instruit, trecem toate înregistrările din setul de date și vedem cum funcționează cursantul de bază. Pentru toate înregistrările care sunt clasificate incorect de către cursantul de bază, le luăm și le transmitem altor studenți de bază spun BL2 și simultan trecem înregistrările incorecte clasificate de BL2 pentru a instrui BL3. Acest lucru va continua dacă nu vom specifica un anumit număr de modele de cursanți de bază de care avem nevoie. În cele din urmă, combinăm ieșirea de la acești cursanți de bază și creăm un elev puternic, ca urmare, puterea de predicție a modelului se îmbunătățește. O.K. Deci, acum știm cum funcționează Bagging-ul și Boosting-ul.

Avantajele și dezavantajele bagajului și stimulării

Mai jos sunt prezentate principalele avantaje și dezavantaje.

Avantajele bagajului

- Cel mai mare avantaj al bagajului este că mai mulți studenți slabi pot funcționa mai bine decât un singur elev puternic.

- Oferă stabilitate și crește acuratețea algoritmului de învățare automată care este utilizat în clasificarea și regresia statistică.

- Ajută la reducerea variației, adică evită supraîncadrarea.

Dezavantajele bagajului

- Poate rezulta o prejudecată mare dacă nu este modelată în mod corespunzător și, prin urmare, poate duce la insuficiență.

- Deoarece trebuie să folosim mai multe modele, acesta devine costisitor din punct de vedere al calculului și poate să nu fie adecvat în diferite cazuri de utilizare.

Avantajele stimulării

- Este una dintre cele mai de succes tehnici în rezolvarea problemelor de clasificare în două clase.

- Este bine să manipulați datele lipsă.

Dezavantaje ale stimulării

- Boosting este greu de implementat în timp real datorită complexității sporite a algoritmului.

- O flexibilitate ridicată a acestor tehnici determină un număr de parametri multipli decât are un efect direct asupra comportamentului modelului.

Concluzie

Principala acțiune este că Bagging and Boosting este o paradigmă de învățare automată în care folosim mai multe modele pentru a rezolva aceeași problemă și pentru a obține o performanță mai bună Și dacă combinăm studenții slabi în mod corespunzător, atunci putem obține un model stabil, precis și robust. În acest articol, am oferit o imagine de ansamblu de bază despre Bagging și Boosting. În articolele viitoare, veți cunoaște diferitele tehnici utilizate în ambele. În sfârșit, voi încheia amintindu-ți că Bagging și Boosting sunt printre cele mai utilizate tehnici de învățare a ansamblurilor. Adevărata artă a îmbunătățirii performanței constă în înțelegerea momentului în care trebuie să folosiți ce model și cum să acordați hiperparametrii.

Articole recomandate

Acesta este un ghid pentru Bagging și Boosting. Aici vom discuta despre Introducere în bagaj și stimulare și lucrează împreună cu Avantaje și dezavantaje. Puteți parcurge și alte articole sugerate pentru a afla mai multe -

- Introducere în tehnici de ansamblare

- Categorii de algoritmi de învățare a mașinilor

- Algoritm de stimulare a gradientului cu cod de eșantion

- Ce este algoritmul de stimulare?

- Cum se creează arborele de decizie?