Introducere în arborele decizional în învățarea mașinilor

Arborele de decizii în învățarea mașinilor a obținut un domeniu larg în lumea modernă. Există o mulțime de algoritmi în ML care este utilizat în viața noastră de zi cu zi. Unul dintre algoritmii importanți este Tree Tree, care este utilizat pentru clasificare și, de asemenea, o soluție pentru probleme de regresie. Deoarece este un model predictiv, Analiza Arborelor de Decizie se face prin abordare algoritmică, unde un set de date este împărțit în subseturi, conform condițiilor. Numele în sine spune că este un model asemănător unui arbore, sub forma unor declarații if-then-else. Cu cât este mai adânc arborele și mai multe sunt nodurile, cu atât modelul este mai bun.

Tipuri de arbore de decizie în învățarea mașinii

Tree Tree este un grafic asemănător unui arbore în care sortarea începe de la nodul rădăcină la nodul frunzei până la atingerea țintei. Este cel mai popular pentru decizie și clasificare bazat pe algoritmi supravegheați. Este construit prin partiționare recursivă în care fiecare nod acționează ca un caz de test pentru unele atribute și fiecare muchie, derivând din nod, este un răspuns posibil în cazul testului. Atât nodurile rădăcină cât și frunzele sunt două entități ale algoritmului.

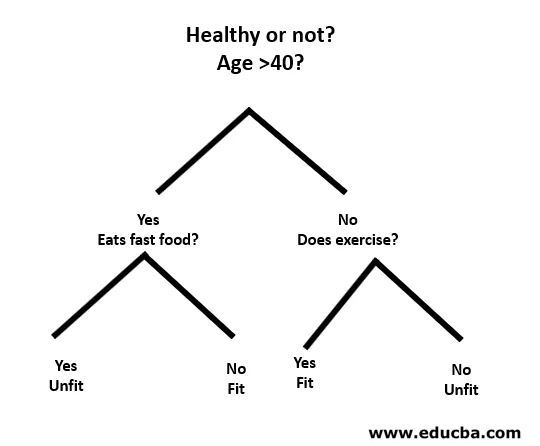

Să înțelegem cu ajutorul unui mic exemplu după cum urmează:

Aici, nodul rădăcină este dacă aveți mai puțin de 40 de ani sau nu. Dacă da, atunci mănânci fast-food? Dacă da, atunci sunteți nepotrivit sau, altfel, sunteți în formă. Și dacă ai peste 40 de ani, atunci faci exerciții fizice? Dacă da, atunci sunteți în formă, altfel sunteți nepotrivit. Aceasta a fost practic o clasificare binară.

Există două tipuri de arbori de decizie:

- Arbori de clasificare: Exemplul de mai sus este un arbore de clasificare bazat pe categorii.

- Arbori de regresie : în acest tip de algoritm, decizia sau rezultatul este continuu. Are o singură ieșire numerică cu mai multe intrări sau predictori.

În arborele Deciziei, provocarea tipică este identificarea atributului la fiecare nod. Procesul se numește selectarea atributelor și are unele măsuri de utilizat pentru a identifica atributul.

A. Câștig informațional (IG)

Informația Castig măsoară cât de multe informații oferă o caracteristică individuală despre clasă. Acționează ca cheie principală pentru construirea unui arbore de decizii. Un atribut cu cel mai mare câștig de informații se împarte mai întâi. Deci, arborele de decizii maximizează întotdeauna câștigul de informații. Când folosim un nod pentru a partiționa instanțele în subseturi mai mici, atunci entropia se schimbă.

Entropie: este măsura incertitudinii sau a impurității într-o variabilă aleatoare. Entropy decide modul în care un arbore de decizie împarte datele în subseturi.

Ecuația pentru câștigul informațional și entropia sunt următoarele:

Câștig informațional = entropie (părinte) - (medie ponderată * entropie (copii))

Entropie: ∑p (X) jurnal p (X)

P (X) aici este fracția de exemple dintr-o clasă dată.

b. Gini Index

Gini Index este o metrică care decide cât de des ar fi identificat incorect un element ales la întâmplare. Se precizează clar că atributul cu un index Gini scăzut este primit.

Index Gini: 1-∑ p (X) 2

Creație divizată

- Pentru a crea o scindare, mai întâi, trebuie să calculăm scorul Gini.

- Datele sunt împărțite folosind o listă de rânduri având un index al unui atribut și o valoare divizată a acelui atribut. După găsirea setului de date din dreapta și din stânga, putem obține valoarea împărțită cu scorul Gini din prima parte. Acum, valoarea împărțită va fi deciderul în care va avea loc atributul.

- Următoarea parte este evaluarea tuturor divizărilor. Cea mai bună valoare posibilă este calculată prin evaluarea costului împărțirii. Cea mai bună împărțire este folosită ca nod al arborelui decizional.

Construirea unui copac - Arbore de decizie în învățarea mașinii

Există doi pași pentru construirea unui arbore de decizii.

1. Crearea nodurilor terminale

În timp ce creăm nodul terminal, cel mai important lucru este să notăm dacă trebuie să oprim creșterea copacilor sau să continuăm mai departe. Pentru aceasta se pot utiliza următoarele modalități:

- Adâncimea maximă a arborelui: Când arborele atinge numărul maxim de noduri, execuția se oprește acolo.

- Înregistrări de noduri minime: Poate fi definit ca un minim de tipare pe care le solicită un nod. Apoi putem opri adăugarea nodurilor terminale imediat ce obținem înregistrările de noduri minime.

2. Divizare recursivă

Odată creat nodul, putem crea un nod copil recursiv împărțind setul de date și apelând la aceeași funcție de mai multe ori.

prezicere

După construirea unui arbore, predicția se face folosind o funcție recursivă. Același proces de predicție este urmat din nou cu noduri copil stânga sau dreapta și așa mai departe.

Avantajele și dezavantajele arborelui decizional

Mai jos sunt prezentate câteva avantaje și dezavantaje:

avantaje

Arborele decizional are câteva avantaje în învățarea mașinii, după cum urmează:

- Comprensiv: ia în considerare fiecare rezultat posibil al unei decizii și urmărește fiecare nod până la concluzie în consecință.

- Specific: Arborii de decizie alocă o valoare specifică fiecărei probleme, decizii și rezultatelor. Reduce incertitudinea și ambiguitatea și, de asemenea, crește claritatea.

- Simplitate: Tree Tree este unul dintre algoritmii mai ușor și de încredere, deoarece nu are formule sau structuri de date complexe. Pentru calcul sunt necesare doar statistici și matematică simple.

- Versatil: Arborii de decizie pot fi construiți manual folosind matematica și pot fi folosiți și cu alte programe de calculator.

Dezavantaje

Arborele decizional prezintă unele dezavantaje în învățarea mașinii, după cum urmează:

- Arborii de decizii sunt mai puțin potriviți pentru estimarea și sarcinile financiare în care avem nevoie de o valoare (valori) adecvate.

- Este un algoritm de clasificare predispus la erori în comparație cu alți algoritmi de calcul.

- Este costisitor din punct de vedere al calculului. La fiecare nod, împărțirea candidatului trebuie sortată înainte de a constata cel mai bun. Există alte alternative pe care multe entități comerciale le urmează pentru sarcinile financiare, deoarece Arborele de decizie este prea scump pentru evaluare.

- În timp ce lucrează cu variabile continue, Decizia Arbore nu este potrivită ca cea mai bună soluție, deoarece tinde să piardă informații în timp ce clasifică variabilele.

- Uneori este instabil, deoarece mici variații în setul de date pot duce la formarea unui arbore nou.

Concluzie - Arborele decizional în învățarea mașinii

Ca unul dintre cei mai importanți și supervizați algoritmi, Decizia Arborele joacă un rol vital în analiza deciziei în viața reală. Ca model predictiv, este utilizat în multe domenii pentru abordarea sa divizată, care ajută la identificarea soluțiilor bazate pe condiții diferite, fie prin metoda de clasificare, fie de regresie.

Articole recomandate

Acesta este un ghid al Arborelui decizional în învățarea mașinii. Aici discutăm introducerea, tipurile de arbore de decizie în învățarea mașinilor, crearea divizată și construirea unui copac. Puteți parcurge și alte articole sugerate pentru a afla mai multe -

- Tipuri de date Python

- Seturi de date din tabel

- Modelarea datelor Cassandra

- Testarea tabelului decizional

- Top 8 etape ale ciclului de învățare a mașinilor