Ce este Teorema lui Bayes?

Teorema lui Bayes este o rețetă care înfățișează cum să reîmprospăteze probabilitățile teoriilor atunci când este dată dovada. Ea urmărește practic din maximele probabilității condiționale, cu toate acestea, poate fi utilizată pentru a raționa în mod capabil despre o gamă largă de probleme, inclusiv actualizarea convingerilor.

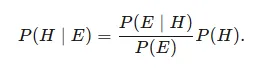

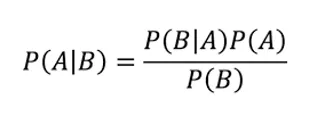

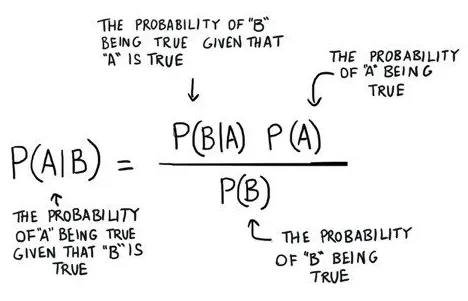

Având în vedere o teorie H și dovada E, teorema lui Bayes exprimă faptul că conexiunea dintre probabilitatea speculației înainte de a obține dovada P (H) și probabilitatea teoriei în urma obținerii probei P (H∣E) este

Este un concept frumos de Probabilitate în care găsim probabilitatea atunci când cunoaștem altă probabilitate

Ce ne spune: cât de regulat se întâmplă A având în vedere că B apare, compus P (A | B),

Când știm: cât de regulat se întâmplă B având în vedere că apare An, compus P (B | A)

în plus, cât de probabil este An fără altcineva, compus P (A)

ba mai mult, cât de probabil este B fără altcineva, compus P (B)

Exemplu al teoremei Bayes

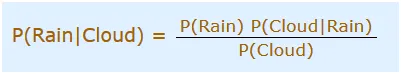

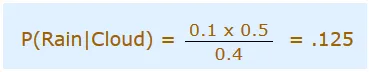

Vă aranjați o excursie astăzi, cu toate acestea, dimineața este înnorată, Dumnezeu ne ajută! jumătate din fiecare zi furtunoasă începe cu umbră! În orice caz, dimineața umbroasă este normală (aproximativ 40% din zile încep să fie înnegrite) În plus, aceasta este, în general, o lună uscată (doar 3 din 30 de zile vor fi, în general, furtunoase sau 10%). Care este probabilitatea scurgerii în timpul zilei? Vom folosi Rain pentru a însemna ploaie în timpul zilei, iar Cloud pentru a însemna dimineață înnorat. Posibilitatea de ploaie oferită de Cloud este compusă din P (Rain | Cloud)

Deci ar trebui să plasăm asta în ecuație:

- P (ploaie) Probabilitate că va fi ploaie = 10% (dat)

- P (Cloud | Ploaie) Probabilitatea ca norii să existe și ploaia să se întâmple = 50%

- P (Cloud) este probabilitatea ca norii să fie acolo = 40%

Deci putem spune că în c:

Aceasta este teorema lui Bayes: că puteți utiliza probabilitatea unui lucru pentru a prevedea probabilitatea altceva. Cu toate acestea, Teorema lui Bayes este orice altceva decât un lucru static. Este o mașină pe care o cheiați pentru a îmbunătăți și prognoze mai bune ca noi suprafețe de dovadă. O activitate intrigantă este aceea de a pune în evidență factorii relevând calitățile teoretice distinctive la P (B) sau P (A) și să ia în considerare efectul lor coerent asupra P (A | B). De exemplu, în cazul în care creșteți numitorul P (B) pe dreapta, la acel moment P (A | B) coboară. Model solid: Un nas curbil este un indiciu al rujeolei, cu toate acestea nasurile curgătoare sunt incontestabil mai tipice decât erupțiile cutanate cu pete albe mici. Adică, în cazul în care alegeți P (B) în cazul în care B este un nas care curge, la acel moment, reapariția naselor curgătoare în publicul general refuză posibilitatea ca nasul curgător să fie un indiciu al rujeolei. Probabilitatea descoperirii rujeolei scade în ceea ce privește efectele secundare care devin progresiv normale; acele manifestări nu sunt indicatoare solide. În mod similar, deoarece rujeola devine din ce în ce mai normală și P (A) urcă în numărătorul din partea dreaptă, P (A | B) urcă în mod esențial, pe motiv că rujeola este pur și simplu mai probabil să acorde puțină minte efectului secundar care tu consideri.

Utilizarea teoremei Bayes în învățarea mașinii

Clasificatorul Naive Bayes

Naive Bayes este un calcul de caracterizare pentru probleme de grupare dublă (două clase) și mai multe clase. Sistemul este cel mai puțin solicitant să fie înțeles atunci când este descris folosind calități informaționale duble sau directe.

Se numește Bayes naive sau Bayes imbecile, având în vedere faptul că calcularea probabilităților pentru fiecare teorie este simplificată pentru a-și face contabilul. Spre deosebire de încercarea de a stabili estimările fiecărei stime de trăsătură P (d1, d2, d3 | h), se consideră că sunt restricționate liber, având în vedere obiectivul în valoare și determinat ca P (d1 | h) * P (d2 | H, etc.

Aceasta este o presupunere solidă care este cea mai îndepărtată în informații autentice, de exemplu, că proprietățile nu comunică. Până la urmă, metodologia are un efect șocant în ceea ce privește informațiile în care această prezumție nu este valabilă.

Portret folosit de modelele Naive Bayes

Portretizarea unui algoritm naiv Bayes este probabilitatea.

Set cu probabilități sunt anulate petiția pentru un model Bayesian naiv savant. Aceasta include:

Probabilitate de clasă: Probabilitatea pentru tot ce există în setul de date de pregătire.

Probabilitatea condițională: Probabilitatea condițională pentru fiecare informație de instanță care merită acordată respectului fiecărei clase.

Luați un model Naive Bayes din date. Preluarea unui model naiv Bayesian de la informațiile despre pregătire este rapidă. Pregătirea este rapidă prin prisma faptului că trebuie determinate valorile de probabilitate pentru fiecare instanță a clasei și trebuie determinate valoarea de probabilitate pentru fiecare instanță a clasei, date specifice informațiilor (x). Niciun coeficient nu trebuie să se potrivească sistemelor de îmbunătățire.

Figurarea probabilităților clasei

O probabilitate de clasă este, practic, reapariția cazurilor care au un loc cu fiecare clasă izolată de numărul complet de cazuri.

De exemplu, într-o clasă paralelă, probabilitatea ca un caz să aibă un loc cu clasa 1 este determinat ca:

Probabilitate (clasă = 1) = total (clasă = 1) / (total (clasă = 0) + total (clasă = 1))

În cel mai simplu caz, fiecare clasă având o probabilitate de 0, 5 sau jumătate pentru o problemă de clasificare dublă, cu un număr similar de apariții în fiecare instanță a clasei.

Figurarea probabilității condiționale

Probabilitățile condiționale sunt reapariția fiecărei stime a trăsăturii pentru o anumită clasă demnă de împărțită de reapariția exemplelor cu respectul de clasă.

Toate aplicațiile teoremei lui Bayes

Există o mulțime de utilizări ale teoremei Bayes în realitate. Încercați să nu vă puneți accentul pe faptul că nu vedeți toată aritmetica inclusă imediat. Pur și simplu obținerea senzației de funcționare este adecvată pentru a începe.

Teoria deciziei bayesiene este o modalitate măsurabilă de a aborda problema clasificării exemplelor. Conform acestei ipoteze, este de așteptat ca transmiterea probabilității de bază pentru clase să fie cunoscută. În acest fel, achiziționăm un clasificator Bayes perfect împotriva căruia orice alt clasificator ia o decizie de execuție.

Vom vorbi despre cele trei utilizări fundamentale ale teoremei lui Bayes:

- Clasificatorul Naive Bayes

- Funcții discriminatorii și suprafețe de decizie

- Bayesian Parameter Estimation

Concluzie

Mărirea și intensitatea teoremei lui Bayes nu se opresc niciodată să mă uimească. O idee de bază, dată de un preot care a transmis peste 250 de ani în urmă, are utilizarea ei în cele mai inconfundabile proceduri AI de astăzi.

Articole recomandate

Acesta este un ghid pentru Teorema lui Bayes. Aici discutăm despre utilizarea teoremei Bayes în învățarea mașinilor și portretul folosit de modelele Naive Bayes cu exemple. De asemenea, puteți arunca o privire la următoarele articole pentru a afla mai multe -

- Algoritmul Naive Bayes

- Tipuri de algoritmi de învățare a mașinilor

- Modele de învățare a mașinilor

- Metode de învățare a mașinilor