Introducere în algoritmul arborelui decizional

Când avem o problemă de rezolvat, care este fie o clasificare, fie o problemă de regresie, algoritmul arborelui decizional este unul dintre cei mai populari algoritmi folosiți pentru construirea modelelor de clasificare și regresie. Acestea se încadrează în categoria învățării supravegheate, adică date care sunt etichetate.

Ce este algoritmul Tree Tree?

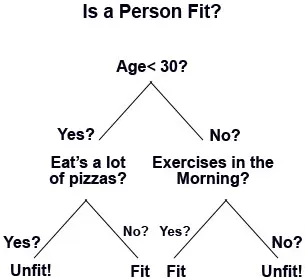

Decizia Algoritmului arborelui este un algoritm de învățare automată supervizat, unde datele sunt împărțite continuu la fiecare rând pe baza anumitor reguli până la generarea rezultatului final. Să luăm un exemplu, să presupunem că deschizi un centru comercial și, desigur, ai vrea să crească în afaceri cu timpul. Așadar, pentru această problemă, veți avea nevoie de clienți care returnează plus clienți noi din mall-ul dvs. Pentru aceasta, ați pregăti diferite strategii de afaceri și de marketing, cum ar fi trimiterea de e-mailuri către potențiali clienți; creați oferte și oferte, vizând noi clienți, etc. Dar de unde știm cine sunt potențiali clienți? Cu alte cuvinte, cum clasificăm categoria clienților? La fel ca unii clienți vor vizita o dată pe săptămână, iar alții ar dori să viziteze o dată sau de două ori pe lună, sau unii vor vizita într-un sfert. Deci arborele de decizie este un astfel de algoritm de clasificare care va clasifica rezultatele în grupuri până nu mai rămâne nici o asemănare.

În acest fel, arborele decizional coboară într-un format structurat. Principalele componente ale unui arbore decizional sunt:

- Nodurile de decizie, care este locul în care datele sunt împărțite sau spun, este un loc pentru atribut.

- Link Link, care reprezintă o regulă.

- Fișele de decizie, care sunt rezultatele finale.

Funcționarea algoritmului arborelui decizional

Există mai mulți pași care sunt implicați în elaborarea unui arbore de decizie:

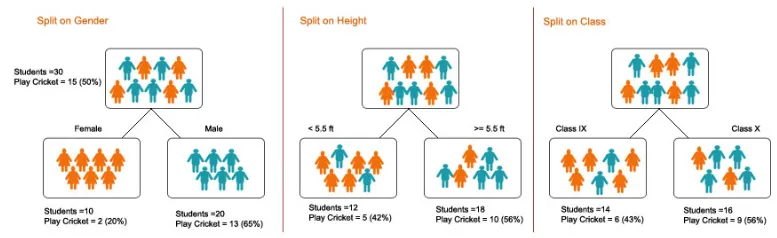

1. Divizare - Este procesul de partitionare a datelor în subseturi. Divizarea se poate face pe diverși factori, așa cum se arată mai jos, adică pe bază de sex, înălțime sau în funcție de clasă.

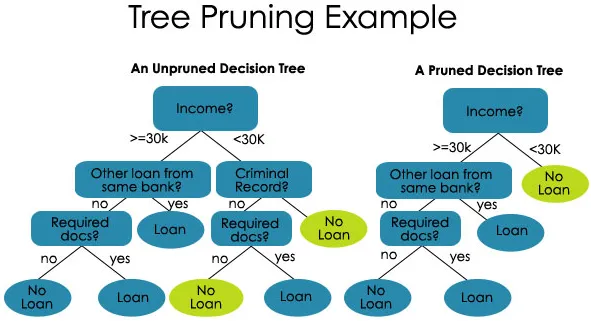

2. Tăierea - Este procesul de scurtare a ramurilor arborelui decizional, astfel limitând adâncimea arborelui

Tăierea este, de asemenea, de două tipuri:

- Pre-pruning - Aici oprim creșterea arborelui atunci când nu găsim nici o asociere semnificativă statistic între atribute și clasă la un nod particular.

- Post-pruning - Pentru a posta prune, trebuie să validăm performanța modelului de set de teste și apoi să tăiem ramurile care sunt rezultatul suprafuncției zgomotului din setul de antrenament.

3. Selecția arborelui - Al treilea pas este procesul de a găsi cel mai mic arbore care se potrivește cu datele.

Exemple și ilustrare a construcției unui arbore de decizie

Acum, după cum am învățat principiile unui arbore de decizie. Să înțelegem și să ilustrăm acest lucru cu ajutorul unui exemplu.

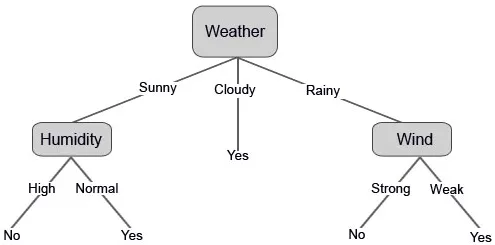

Să zicem că vrei să joci cricket într-o anumită zi (De exemplu, sâmbătă). Care sunt factorii care sunt implicați care vor decide dacă piesa va avea loc sau nu?

În mod clar, factorul major este climatul, niciun alt factor nu are atâta probabilitate, cât și climă are întreruperea jocului.

Am colectat datele din ultimele 10 zile, care sunt prezentate mai jos:

| Zi | Vreme | Temperatura | Umiditate | Vânt | Joaca? |

| 1 | Noros | Fierbinte | Înalt | Slab | da |

| 2 | Însorit | Fierbinte | Înalt | Slab | Nu |

| 3 | Însorit | Blând | Normal | Puternic | da |

| 4 | Ploios | Blând | Înalt | Puternic | Nu |

| 5 | Noros | Blând | Înalt | Puternic | da |

| 6 | Ploios | Misto | Normal | Puternic | Nu |

| 7 | Ploios | Blând | Înalt | Slab | da |

| 8 | Însorit | Fierbinte | Înalt | Puternic | Nu |

| 9 | Noros | Fierbinte | Normal | Slab | da |

| 10 | Ploios | Blând | Înalt | Puternic | Nu |

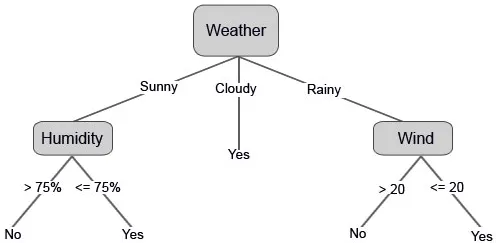

Să ne construim acum arborele decizional pe baza datelor pe care le-am obținut. Astfel, am împărțit arborele decizional în două niveluri, primul se bazează pe atributul „Vremea”, iar al doilea rând se bazează pe „Umiditate” și „Vânt”. Imaginile de mai jos ilustrează un arbore de decizie învățat.

De asemenea, putem seta anumite valori de prag dacă funcțiile sunt continue.

Ce este Entropia în algoritmul Tree Tree?

În cuvinte simple, entropia este măsura cât de dezordonate sunt datele dvs. Deși ați auzit acest termen în cursurile dvs. de Matematică sau Fizică, este același lucru aici.

Motivul pentru care se utilizează entropia în arborele decizional se datorează faptului că scopul final din arborele decizional este acela de a grupa grupuri de date similare în clase similare, adică de a ordona datele.

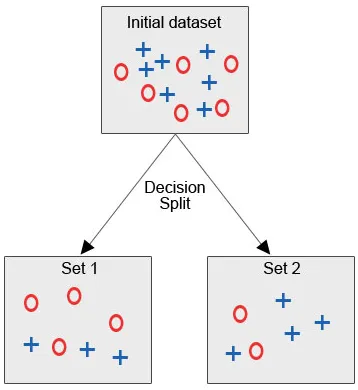

Să vedem imaginea de mai jos, unde avem setul de date inițial și trebuie să aplicăm algoritmul arborelui decizional pentru a grupa punctele de date similare dintr-o categorie.

După împărțirea deciziei, așa cum putem vedea clar, majoritatea cercurilor roșii se încadrează într-o clasă, în timp ce majoritatea crucilor albastre intră sub o altă clasă. Prin urmare, o decizie a fost de a clasifica atributele care ar putea fi bazate pe diverși factori.

Acum, să încercăm să facem niște matematici aici:

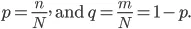

Să spunem că avem seturi „N” ale articolului și aceste articole se încadrează în două categorii, iar acum pentru a grupa datele bazate pe etichete, introducem raportul:

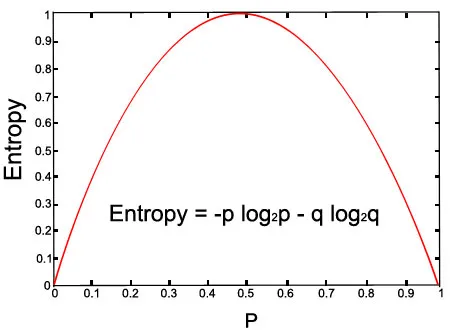

Entropia setului nostru este dată de următoarea ecuație:

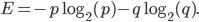

Să verificăm graficul pentru ecuația dată:

Imaginea de sus (cu p = 0, 5 și q = 0, 5)

avantaje

1. Un arbore de decizie este simplu de înțeles și odată ce este înțeles, îl putem construi.

2. Putem implementa un arbore decizional atât pe date numerice cât și pe categorii.

3. Arborele de decizie este dovedit a fi un model robust, cu rezultate promițătoare.

4. De asemenea, sunt eficiente în timp cu date mari.

5. Necesită mai puțin efort pentru pregătirea datelor.

Dezavantaje

1. Instabilitate - Numai dacă informațiile sunt precise și exacte, arborele de decizie va oferi rezultate promițătoare. Chiar dacă există o ușoară modificare a datelor de intrare, aceasta poate provoca schimbări mari în arbore.

2. Complexitate - Dacă setul de date este imens cu multe coloane și rânduri, este o sarcină foarte complexă să proiectăm un arbore de decizie cu multe ramuri.

3. Costuri - Uneori, costul rămâne, de asemenea, un factor principal, deoarece atunci când se cere construirea unui arbore de decizie complex, este nevoie de cunoștințe avansate în analiza cantitativă și statistică.

Concluzie

În acest articol, am aflat despre algoritmul arborelui decizional și cum să construim unul. Am văzut, de asemenea, rolul mare pe care îl joacă Entropy în algoritmul arborelui decizional și, în sfârșit, am văzut avantajele și dezavantajele arborelui decizional.

Articole recomandate

Acesta a fost un ghid pentru Algoritmul Tree Tree. Aici am discutat despre rolul jucat de Entropy, Working, Avantaje și Dezavantaj. Puteți parcurge și alte articole sugerate pentru a afla mai multe -

- Metode importante de extragere a datelor

- Ce este aplicația web?

- Ghid pentru Ce este știința datelor?

- Întrebări de interviu pentru analistul datelor

- Aplicarea arborelui decizional în extragerea datelor